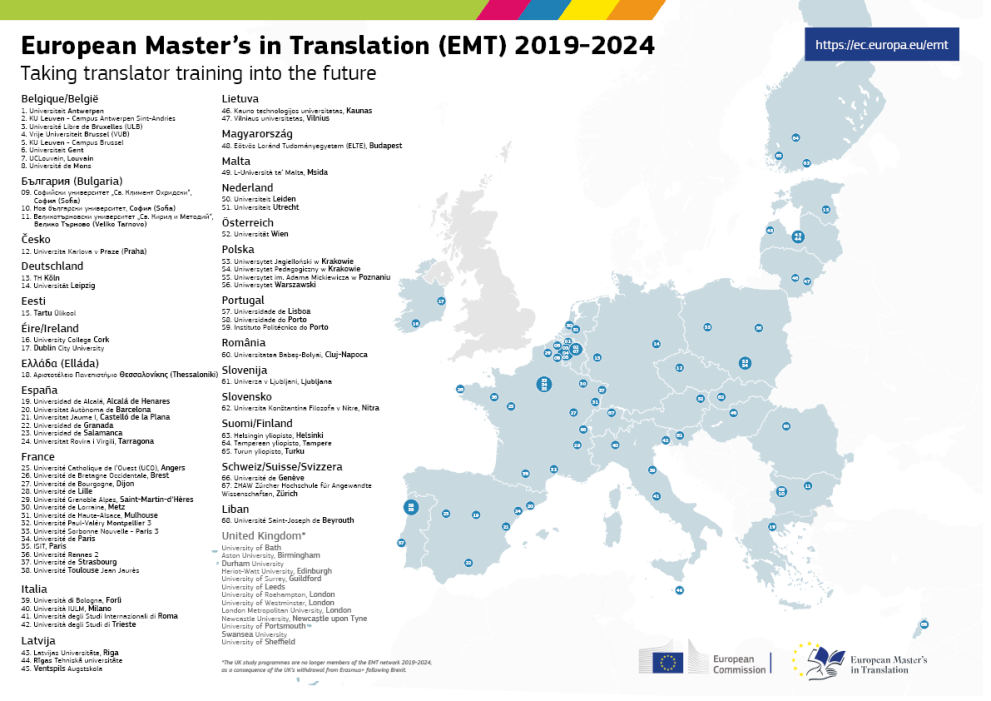

Welcome to the blog of the European Master’s in Translation (EMT) network of the European Commission’s Directorate-General for Translation (DGT). This network of Master’s programmes aims to improve the quality of translator training in order to enhance the labour market integration of young language professionals. The EMT competence framework is at the core of the project. It defines the basic competences that translators need to work successfully in today’s market. By cooperating closely with the language industry the EMT network ensures that academic translator training meets the real needs of the profession.

The aim of the blog is to give an insight into the training for a profession that is rather little known to the public. It complements the #DiscoverTranslation campaign of the DGT.

On this blog you will find contributions relating to the translation profession. These are written by professors, trainers, students and graduates participating in programmes that are part of the network. You will also find guest contributions by language industry experts. The Blog posts are written in one of the 24 official languages of the European Union, along with a translation in English.

The topics discussed are related to the translation profession as practiced and taught today all over Europe.

Each blog post belongs to a specific category:

Activities of the EMT network: meetings, events, network collaborations.

Professional experience/employability: what kind(s) of professional experience is available and valuable for trainees? What happens to students once they have graduated?

Pedagogical initiatives: how are the different career paths within the translation profession taught today?

Translation technology: what tools are best for work in the language services sector and for student training?

Translation competences: what competences are required on the translation market? How to teach them?

Translation issues: discussion on translation strategies, choices, quality…

Check out the articles published in the language of your choice:

BG – DE – EL – EN – ES – FI – FR – HU – IT – LT – LV – NL – PT – RO

EMT Blog latest articles

By Bianca Banica, student at the Université Grenoble Alpes, Master Langues étrangères appliquées

- Language

- English

- Romanian

- EMT Category

- Activities of the EMT network

By Sandra Castelló Gil, student of the Master in Translation and Intercultural Mediation, University of Salamanca, Spain

- Language

- English

- EMT Category

- Professional experience/employability

- Translation competences

Par Guillaume Deneufbourg et Daria Balandina, Université de Mons (Belgique)

- Language

- français

- EMT Category

- Expérience professionnelle/Employabilité

- Compétences en traduction

By Dr. Enikő BENEDEK, Lecturer and Translation Technologist Course Leader, Eötvös Loránd University, Department of Translation and Interpreting

- Language

- English

- Hungarian

- EMT Category

- Pedagogical initiatives